Lucion山東國信家族信托產品品牌推廣與軟件開發策略

隨著財富管理市場的快速發展,家族信托作為一種高效的財富傳承和資產規劃工具,受到越來越多高凈值人群的青睞。Lucion山東國信作為專業的信托服務提供商,其家族信托產品的品牌推廣和軟件開發是關鍵環節,旨在提升品牌認知度、增強用戶體驗,并推動業務增長。以下是針對該產品的品牌推廣設計和軟件開發的綜合策略。

一、品牌推廣設計策略

品牌推廣是提升Lucion山東國信家族信托產品市場影響力的核心。品牌定位應聚焦于“專業、安全、定制化”,突出其在財富傳承、風險隔離和稅務優化方面的優勢。設計元素上,采用簡約而富有質感的視覺風格,如深藍色調象征信托和高端服務,搭配金色點綴體現財富感。標志設計可融入家族傳承的象征,如樹木或鑰匙元素,傳遞長久守護的理念。

多渠道推廣是擴大覆蓋面的關鍵。線上部分,利用社交媒體(如微信公眾號、LinkedIn)發布行業洞察、成功案例和專家訪談,吸引目標客戶;通過搜索引擎優化(SEO)和付費廣告提升在線可見性。線下活動包括舉辦財富管理論壇、客戶沙龍和高端展會,與潛在客戶面對面交流,建立信任關系。合作金融機構和律師事務所,進行聯合推廣,擴大品牌輻射范圍。內容營銷方面,制作白皮書、視頻教程和博客文章,教育客戶家族信托的價值,增強品牌權威性。

二、軟件開發策略

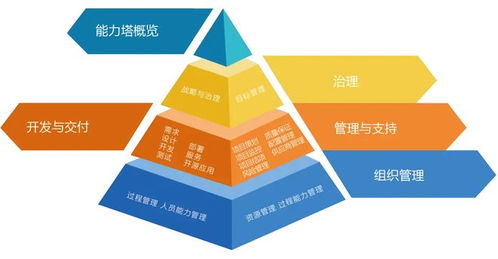

軟件開發是確保家族信托產品高效、安全運行的基礎。Lucion山東國信應構建一個集成的家族信托管理平臺,涵蓋客戶管理、資產配置、風險監控和報告生成等功能。軟件設計需注重用戶友好性,采用直觀的界面和模塊化結構,方便客戶和內部團隊使用。

在技術實現上,采用云計算和微服務架構,確保系統可擴展性和高可用性。數據安全是重中之重,通過加密傳輸、多因素認證和定期安全審計,保護客戶隱私和資產信息。集成AI和大數據分析功能,提供個性化建議和風險預警,提升服務智能化水平。移動端App開發也必不可少,支持客戶隨時隨地查看信托狀態、提交需求和接收通知,優化用戶體驗。

三、整合與執行

品牌推廣與軟件開發應相輔相成。推廣活動可通過軟件平臺收集用戶反饋,持續優化產品;反之,軟件的先進功能可作為推廣亮點,吸引更多客戶。建議成立跨部門團隊,定期評估市場反應和技術進展,確保策略靈活調整。最終目標是打造Lucion山東國信家族信托產品為行業標桿,助力客戶實現財富永續傳承。

如若轉載,請注明出處:http://www.gangganbao.cn/product/32.html

更新時間:2026-05-26 06:04:12